```html

Otonom 'Katil Robotlar' Çağı Başlıyor mu? Pentagon'dan Tartışmalı Yatırım Hamlesi

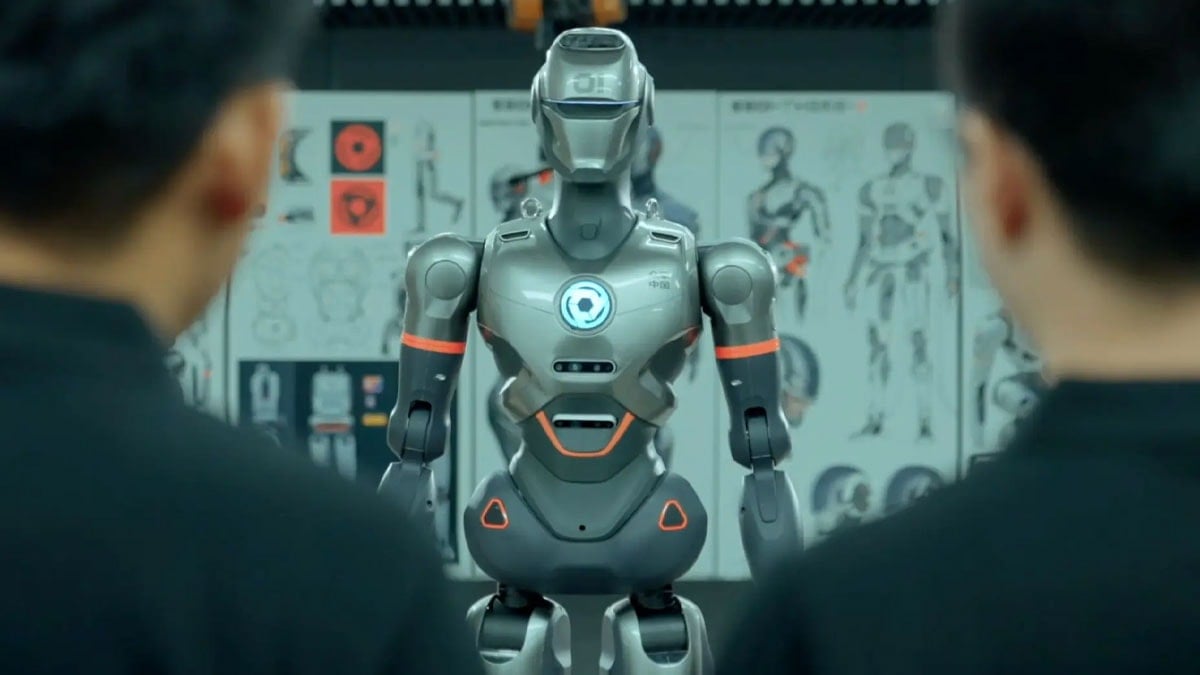

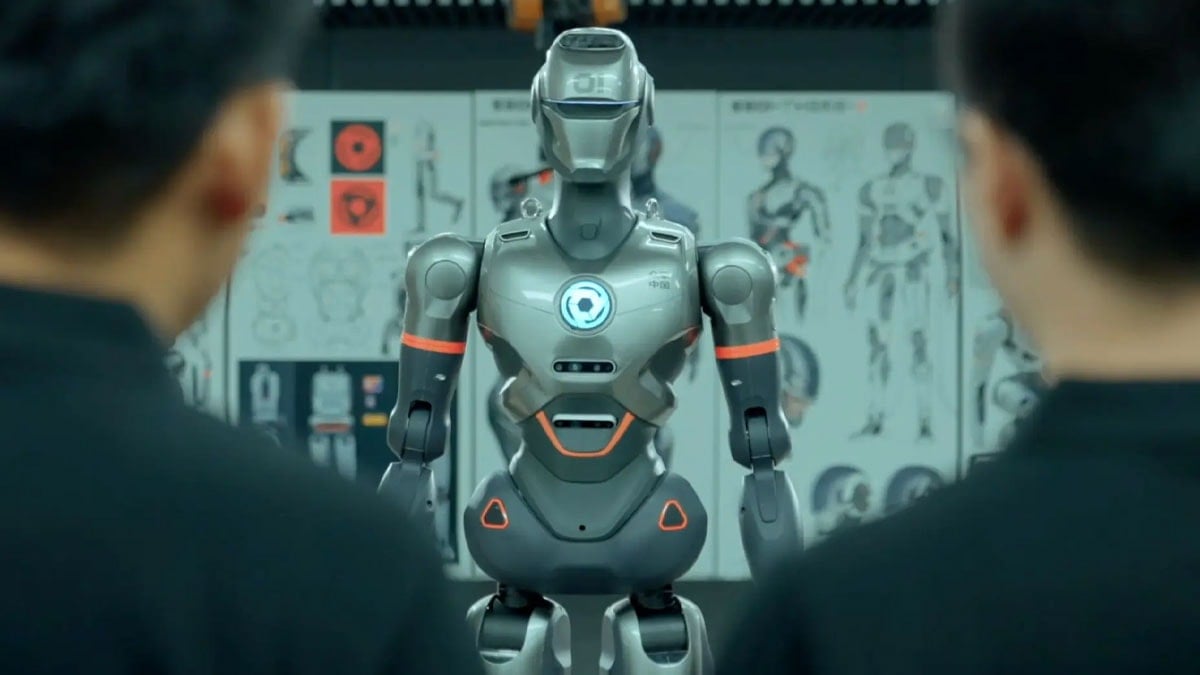

Bilim Kurgu Gerçeğe Dönüşüyor: Pentagon, İnsan Müdahalesi Olmadan Karar Verebilen Savaş Robotlarına Yöneliyor

Teknoloji dünyası ve askeri strateji çevreleri, Pentagon'un son açıklamasıyla adeta çalkalanıyor. Film sahnelerinden aşina olduğumuz, kendi başına hareket edebilen ve karar alabilen otonom savaş robotları gerçeğe mi dönüşüyor? Geçtiğimiz günlerde üst düzey Pentagon yetkilileri, yapay zeka destekli, insan kontrolüne ihtiyaç duymayan 'otonom katil robotlar' olarak da adlandırılan sistemlere yatırım yapacaklarını duyurdu. Bu açıklama, beraberinde hem büyük bir teknolojik devrimi hem de derin etik tartışmaları tetikledi.

Haberin Detayları: Otonom Silah Sistemlerine Yeşil Işık

Pentagon yetkililerinin yaptığı açıklamaya göre, bu yatırım kararı, askeri teknolojide yaşanan hızlı gelişmelere ayak uydurma ve gelecekteki savaş alanlarında üstünlük sağlama amacı taşıyor. Yetkililer, otonom silah sistemlerinin, özellikle karmaşık ve hızlı değişen çatışma ortamlarında insan askerlerin tepki süresini aşan tehditlere karşı daha etkili bir savunma sağlayabileceğini vurguluyor. Bu sistemlerin, düşman hedeflerini belirleme, angajman kurallarını uygulama ve hatta ateş açma gibi kritik kararları insan müdahalesi olmadan gerçekleştirebilmesi hedefleniyor.

Kararın zamanlaması ve detayları net olarak belirtilmese de, Pentagon'un bu yöndeki Ar-Ge çalışmalarına hız verdiği ve yakın gelecekte prototiplerin test aşamasına geçilebileceği tahmin ediliyor. Bu gelişme, sadece ABD'nin değil, diğer büyük askeri güçlerin de benzer teknolojilere yatırım yapma yarışına girmesine neden olabilir.

Teknik Özellikler ve Yenilikler: Yapay Zeka ve Otonomi Ön Planda

Otonom katil robotların temelinde, gelişmiş yapay zeka (YZ) ve makine öğrenimi algoritmaları yatıyor. Bu sistemler, çevrelerini sensörler (kameralar, radarlar, lidar vb.) aracılığıyla algılayacak, topladıkları veriyi işleyerek durumu analiz edecek ve önceden programlanmış hedeflere ve kurallara göre kararlar alabilecek.

Beklenen teknik özelliklerden bazıları:

- Gelişmiş Algılama ve Tanımlama: Yüksek çözünürlüklü sensörler ve görüntü işleme algoritmaları sayesinde düşman unsurlarını, sivilleri ve dost birlikleri ayırt edebilme.

- Otonom Navigasyon ve Hedef Takibi: Zorlu arazi koşullarında ve dinamik ortamlarda bağımsız hareket edebilme, hedefleri algılayıp takip edebilme.

- Karar Verme Mekanizmaları: Karmaşık durumlarda risk analizi yapabilme, taktiksel kararlar alabilme ve angajman kurallarını uygulayabilme.

- Ağ Bağlantısı ve Koordinasyon: Merkezi komuta ile iletişim kurabilme, diğer otonom sistemlerle koordineli çalışabilme.

- Sürekli Öğrenme Yeteneği: Makine öğrenimi sayesinde operasyonel verilerden öğrenerek performansını sürekli geliştirme.

Bu teknolojinin yeniliği, savaşın doğasını temelden değiştirebilecek potansiyele sahip olması. İnsan askerlerin risk altına girmeden görev yapabilmesi, savaş hızının artması ve olası askeri kayıpların azalması gibi avantajlar sunabilir. Ancak, bu otonomi seviyesi beraberinde etik, hukuki ve güvenlik risklerini de getiriyor.

Artıları ve Eksileri

Artıları:

- Askeri Personel Kayıplarını Azaltma: En büyük avantajı, insan askerlerin savaş alanındaki riskini ortadan kaldırması. Tehlikeli görevler robotlar tarafından üstlenilebilir.

- Hızlı Tepki Süresi: Yapay zeka, insanlardan çok daha hızlı karar alıp tepki verebilir, özellikle saniyeler içinde karar verilmesi gereken durumlarda avantaj sağlar.

- Yorulmama ve Duygusallıktan Arınmış Kararlar: Robotlar yorulmaz, duygusal veya psikolojik faktörlerden etkilenmez, bu da daha tutarlı ve objektif kararlar alınmasını sağlayabilir.

- 24/7 Operasyon Kabiliyeti: İnsanların aksine sürekli görev yapabilir, gece gündüz fark etmeksizin operasyonel etkinlik sağlar.

Eksileri:

- Etik ve Ahlaki Sorunlar: İnsan hayatına kimin karar vereceği sorusu. Otonom sistemlerin savaş suçu işlemesi veya masum sivilleri hedef alması durumunda sorumluluk kimde olacak?

- Teknolojik Güvenilirlik ve Hata Riski: Yapay zeka sistemleri mükemmel değildir ve hatalar yapabilir. Yazılım hataları, siber saldırılar veya beklenmedik durumlar sistemin kontrolünü kaybetmesine yol açabilir.

- Kontrolden Çıkma ve Silahlanma Yarışı: Otonom silahların yaygınlaşması, kontrolsüz bir silahlanma yarışını tetikleyebilir ve öngörülemeyen sonuçlara yol açabilir.

- Savaşın İnsani Boyutunun Kaybolması: Savaşın tamamen teknolojiye dayalı hale gelmesi, diplomasinin ve barışçıl çözümlerin önemini azaltabilir, insanlık dışı bir savaş anlayışını teşvik edebilir.

- Algoritmik Önyargı ve Ayrımcılık: Yapay zeka algoritmaları, geliştiricilerin önyargılarını yansıtabilir, bu da otonom sistemlerin ayrımcı veya adaletsiz kararlar almasına neden olabilir.

Alternatifler

Otonom silah sistemlerine alternatif olarak değerlendirilebilecek yaklaşımlar ve teknolojiler şunlar olabilir:

- İnsan Kontrollü Uzaktan Kumandalı Sistemler: Dronlar ve uzaktan kumandalı robotlar gibi sistemler, insan operatörlerin kontrolünde daha hassas ve etik kararlar alabilmesini sağlar. Otonominin kademeli olarak artırılması ve insan kontrolünün her zaman öncelikli olması prensibi benimsenebilir.

- Gelişmiş Savunma Sistemleri: Saldırıları engellemeye yönelik savunma teknolojilerine yatırım yapmak, savaşın yıkıcı etkilerini azaltabilir. Füze savunma sistemleri, siber güvenlik önlemleri ve erken uyarı sistemleri gibi teknolojiler geliştirilebilir.

- Diplomasi ve Barışçıl Çözümler: Uluslararası işbirliği, diplomatik görüşmeler ve çatışma çözme mekanizmaları güçlendirilerek, savaşın önlenmesi ve barışın tesisi için çaba gösterilmelidir.

- Etik Çerçeveler ve Uluslararası Anlaşmalar: Otonom silah sistemlerinin geliştirilmesi ve kullanımı konusunda uluslararası etik standartlar belirlenmeli, bağlayıcı anlaşmalar ve düzenlemeler oluşturulmalıdır. Yapay zeka etiği, insan hakları ve uluslararası hukuk prensipleri çerçevesinde hareket edilmelidir.

Uzman Yorumları ve Analiz

Dr. Elara Demir (Yapay Zeka Etikçisi): "Otonom silah sistemleri, insanlık için ciddi bir dönüm noktası oluşturuyor. Teknoloji harika bir potansiyele sahip olsa da, etik ve ahlaki riskleri göz ardı edilmemeli. En büyük endişem, bu sistemlerin hesap verebilirliğinin ve kontrol mekanizmalarının yetersiz kalma ihtimali. Uluslararası toplum, bu konuda acilen ortak bir zeminde buluşmalı ve sorumlu bir yaklaşım benimsemeli."

Emekli General Kenan Yılmaz (Askeri Stratejist): "Otonom sistemler, askeri stratejileri kökten değiştirecek. Savaş alanında hız ve etkinlik avantajı sağlayacakları kesin. Ancak, teknolojinin askeri doktrinlere entegrasyonu çok dikkatli yapılmalı. İnsan unsurunun tamamen devreden çıkarılması, öngörülemeyen sonuçlar doğurabilir. Otonomi seviyesi kademeli olarak artırılmalı ve insan kontrolü her zaman bir seçenek olarak kalmalı."

Prof. Dr. Ayşe Kaya (Hukukçu): "Uluslararası hukuk açısından otonom silah sistemleri büyük bir boşluk yaratıyor. Mevcut savaş hukuku kuralları, bu tür teknolojilere tam olarak uygulanamıyor. Özellikle sorumluluk, ayrım ilkesi ve orantılılık gibi temel prensiplerin yeniden tanımlanması gerekiyor. Uluslararası toplum, bu konuda yasal bir çerçeve oluşturmak için harekete geçmelidir."

Sonuç / Değerlendirme

Pentagon'un otonom katil robotlara yatırım kararı, teknoloji ve askeri strateji dünyasında yeni bir dönemin başlangıcını işaret ediyor. Bu gelişme, askeri operasyonlarda etkinlik ve hız gibi avantajlar sunsa da, beraberinde ciddi etik, hukuki ve güvenlik risklerini de getiriyor. Otonom silah sistemlerinin geleceği, uluslararası toplumun bu teknolojilere nasıl yaklaştığına, etik ve yasal düzenlemelerin ne kadar etkili olduğuna ve insanlığın sorumlu bir şekilde teknolojiye yön verme becerisine bağlı olacak. Bu sadece bir teknolojik gelişme değil, aynı zamanda insanlığın geleceği için kritik bir karar anı.

Kaynaklar ve Ek Bilgiler

```

Eiket Bulutu:

Paylaş :

Yorum :